Visitas: 0

La Inteligencia Artificial (IA) se ha convertido en una fuerza imparable, transformando rápidamente la forma en que vivimos, trabajamos e interactuamos con el mundo. Su potencial para revolucionar la medicina, la educación, la industria y la vida cotidiana es innegable, abriendo un sinfín de posibilidades para el progreso humano. Sin embargo, como toda tecnología poderosa, la IA también presenta riesgos que deben ser cuidadosamente considerados y mitigados.

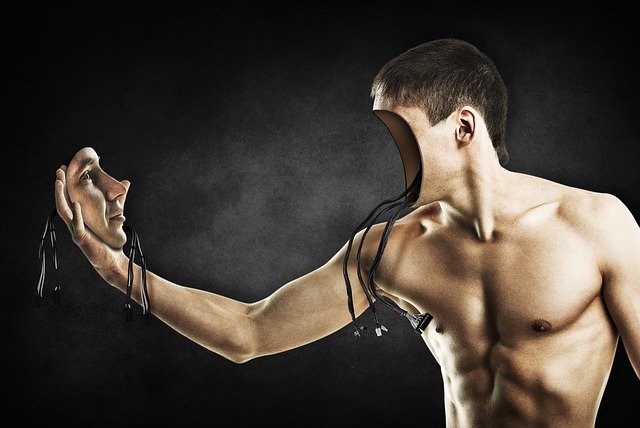

La frase «las tecnologías no son ni buenas ni malas, son neutras» es una peligrosa simplificación de la realidad. La IA, como cualquier herramienta, puede ser utilizada para el bien o para el mal. El desarrollo de armas autónomas, la propagación de información falsa y la discriminación algorítmica son solo algunos ejemplos de los potenciales riesgos de una IA no controlada.

Por supuesto, los que dominan las tecnologías no desean que se ejerza ningún control sobre ellas, para que ellos se beneficien al máximo, y sin importarles nada más: solo su propio beneficio. Por eso siempre dicen lo mismo, que los controles impiden el desarrollo tecnológico, y bla.. bla … es siempre la misma mentira, que ya no engaña a nadie.

Es crucial entender que la IA no es una entidad independiente con intenciones propias. Son sistemas creados por humanos, reflejando nuestros propios sesgos, valores y limitaciones. Por lo tanto, la responsabilidad de la IA recae en nosotros. Debemos asegurar que su desarrollo y aplicación estén guiados por principios éticos, buscando maximizar los beneficios para la sociedad y minimizar los riesgos.

El control de la IA no implica frenar la innovación, sino crear un marco robusto que permita su desarrollo responsable. Esto implica:

1. Transparencia y Explicabilidad: Los algoritmos de IA deben ser transparentes y sus decisiones explicables. La «caja negra» de la IA debe ser abierta a la inspección para comprender su funcionamiento y detectar posibles sesgos.

2. Prevención de sesgos: Los datos utilizados para entrenar la IA deben ser diversos y representativos para evitar la perpetuación de discriminaciones existentes en la sociedad.

3. Seguridad y Privacidad: Los sistemas de IA deben ser diseñados para proteger la seguridad y privacidad de los datos personales. Se necesitan mecanismos robustos para prevenir la manipulación, el robo o la violación de datos.

4. Responsabilidad y Rendición de Cuentas: Los desarrolladores de IA deben ser responsables de las acciones de sus sistemas y deben existir mecanismos para responsabilizar a quienes abusen de esta tecnología.

5. Ética y Valores Humanos: La IA debe ser diseñada y aplicada en concordancia con los valores humanos fundamentales, como la justicia, la equidad, la libertad y la dignidad.

6. Colaboración Global: El control de la IA requiere una cooperación internacional. Es necesaria una acción coordinada entre gobiernos, empresas y organizaciones para establecer normas y estándares globales.

La reciente aprobación de leyes de IA en Europa y California son pasos importantes en la dirección correcta. Estas leyes buscan establecer un marco regulatorio para la IA, asegurando que su desarrollo y aplicación se ajusten a principios éticos y de seguridad. Sin embargo, aún queda mucho camino por recorrer.

Las empresas tecnológicas tienen un rol crucial en este proceso. Deben comprometerse con la transparencia, la ética y la responsabilidad en el desarrollo y la aplicación de la IA. La sociedad civil, los gobiernos y las instituciones académicas también deben participar activamente en el debate público sobre la IA, asegurando que se escuchen todas las voces y se tomen decisiones informadas.

La IA tiene el potencial de ser una herramienta poderosa para el bien social, pero su desarrollo debe ser cuidadosamente guiado. El control de la IA no es una limitación a la innovación, sino un imperativo moral y social. Solo a través de un enfoque responsable y ético podemos aprovechar el potencial de la IA para construir un futuro mejor para todos.

Esperemos que así sea, aunque las empresas involucradas se van a resistir con uñas y dientes. Hay mucho dinero en juego, y no podemos ser ingenuos.