Visitas: 1

Hace poco, durante una conversación con un buen amigo, él me decía con determinación que no quería saber nada de la inteligencia artificial. Que prefería mantenerse al margen, vivir su vida sin meterse en ese mundo que, según él, todavía podía evitar. Le escuché con atención, pero al final no pude más que sonreír. Porque aunque su postura era comprensible desde lo humano, también era profundamente ingenua. Hoy, usar o no usar la inteligencia artificial no es una decisión que podamos tomar de forma individual. La IA ya nos ha incluido en su ecuación, lo sepamos o no, lo queramos o no.

Vivimos en una época en la que la inteligencia artificial está incrustada en el tejido de las sociedades modernas. Las grandes empresas la utilizan para todo: desde análisis de datos, marketing, atención al cliente, gestión logística, hasta recursos humanos. Y no se trata de una tendencia emergente, sino de una realidad consolidada que se expande día tras día.

Pongamos un ejemplo muy sencillo: imaginemos a alguien que nunca ha utilizado ChatGPT, ni ha interactuado con ningún asistente de voz, ni ha tocado una sola herramienta de IA de forma directa. Aun así, esa persona probablemente haya hecho compras en plataformas que utilizan IA para predecir su comportamiento, o ha sido grabada por cámaras de seguridad con reconocimiento facial, o ha aceptado cookies en sitios web cuyos algoritmos perfilan su navegación. Y, sin saberlo, es muy posible que ya esté en la base de datos de múltiples empresas que alimentan sistemas de inteligencia artificial con información sobre sus hábitos, sus preferencias, sus horarios y hasta sus relaciones.

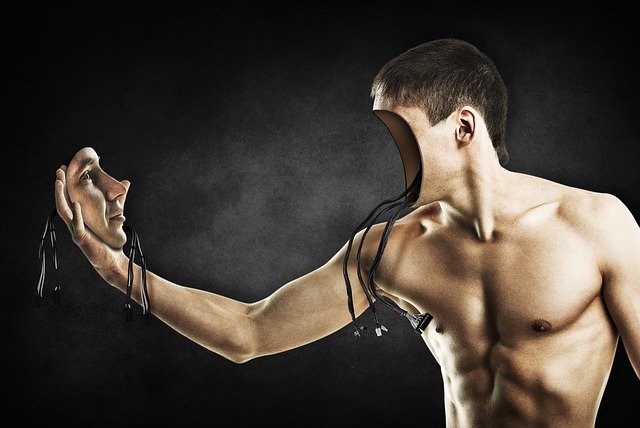

Lo que mi amigo no entendía es que no se trata de elegir si uno quiere «usar» la IA. No se trata de decir “yo paso de eso”. Porque aunque uno no la utilice directamente, ella ya nos está utilizando a nosotros. Nuestros datos forman parte de su aprendizaje. Somos parte del sistema, incluso si creemos no participar en él.

Uno de los ejemplos más claros de esto es el proceso de selección de personal. Hoy en día, en muchas empresas, el primer filtro de candidatos lo realiza un sistema de inteligencia artificial. Si envías tu currículum para optar a un puesto de trabajo, lo más probable es que quien lo lea primero no sea una persona, sino un algoritmo que compara tus datos con miles de perfiles, evalúa palabras clave, títulos académicos, experiencias laborales y mucho más, todo en cuestión de segundos.

Solo si pasas ese primer filtro automático, tu perfil llegará a manos humanas. ¿Y qué ocurre si ese algoritmo ha sido mal diseñado, o tiene sesgos? Pues que quizá nunca tengas la oportunidad de demostrar tu valía, simplemente porque una IA decidió que no encajas en el patrón buscado.

Esto debería preocuparnos. No porque la tecnología sea mala en sí, sino porque su uso no siempre está guiado por principios éticos sólidos. El gran desafío no es detener el avance de la inteligencia artificial —eso sería tan inútil como tratar de detener una marea con las manos—, sino asegurar que ese avance se produzca respetando los derechos individuales y colectivos que tanto ha costado conquistar.

Yo, personalmente, sí utilizo herramientas de inteligencia artificial. Me ayudan a organizar ideas, a escribir, a buscar información, etc …. Y cuanto más la uso, más útil me resulta. Eso sí, soy consciente de que su uso gratuito tiene límites, y también entiendo que detrás hay miles de horas de trabajo, infraestructura y conocimiento que alguien tiene que pagar. Nadie puede esperar que todo esto funcione sin un modelo de sostenibilidad.

Pero repito: el verdadero problema no es el acceso a la herramienta. Es su uso ético. ¿Se utiliza para discriminar? ¿Se respeta la privacidad de los usuarios? ¿Se recopilan datos sin consentimiento? ¿Se manipula la información? Todas esas preguntas deben formar parte del debate actual. Porque si dejamos que las empresas prioricen exclusivamente el rendimiento económico, sin regulaciones ni supervisión, corremos el riesgo de perder el control sobre algo que ya es demasiado poderoso como para dejarlo sin vigilancia.

Por eso, necesitamos que las instituciones públicas, los organismos internacionales y las sociedades civiles se impliquen activamente en establecer límites, reglas y controles. No podemos permitir que unos pocos, con acceso privilegiado a los datos y a la tecnología, decidan el destino de todos los demás. Y tampoco podemos resignarnos con frases como “esto es imparable”. La historia está llena de avances imparables que, sin regulación, terminaron perjudicando a millones de personas.

En resumen, ya no se trata de elegir si queremos convivir con la inteligencia artificial. Esa elección nos fue arrebatada hace tiempo. Ahora, el reto es decidir cómo vamos a convivir con ella, qué límites vamos a exigir y cómo vamos a proteger nuestras libertades en este nuevo escenario tecnológico.

Porque, queridos amigos, mientras nosotros decidimos si usar o no la IA, ella ya ha decidido por nosotros. Y ese es el verdadero giro de esta era.

Se puede ver un video sobre el uso de la IA en: